Mehrere Modelle.

Laden Sie fünf optimierte KI-Modelle herunter und wechseln Sie zwischen ihnen. SmolLM3 für erweiterten Kontext, Phi-4 für tiefes Denken, EXAONE Deep für Mathematik und Code. Alle auf 4-Bit quantisiert für effiziente On-Device-Inferenz. Nach dem Download offline verfügbar.

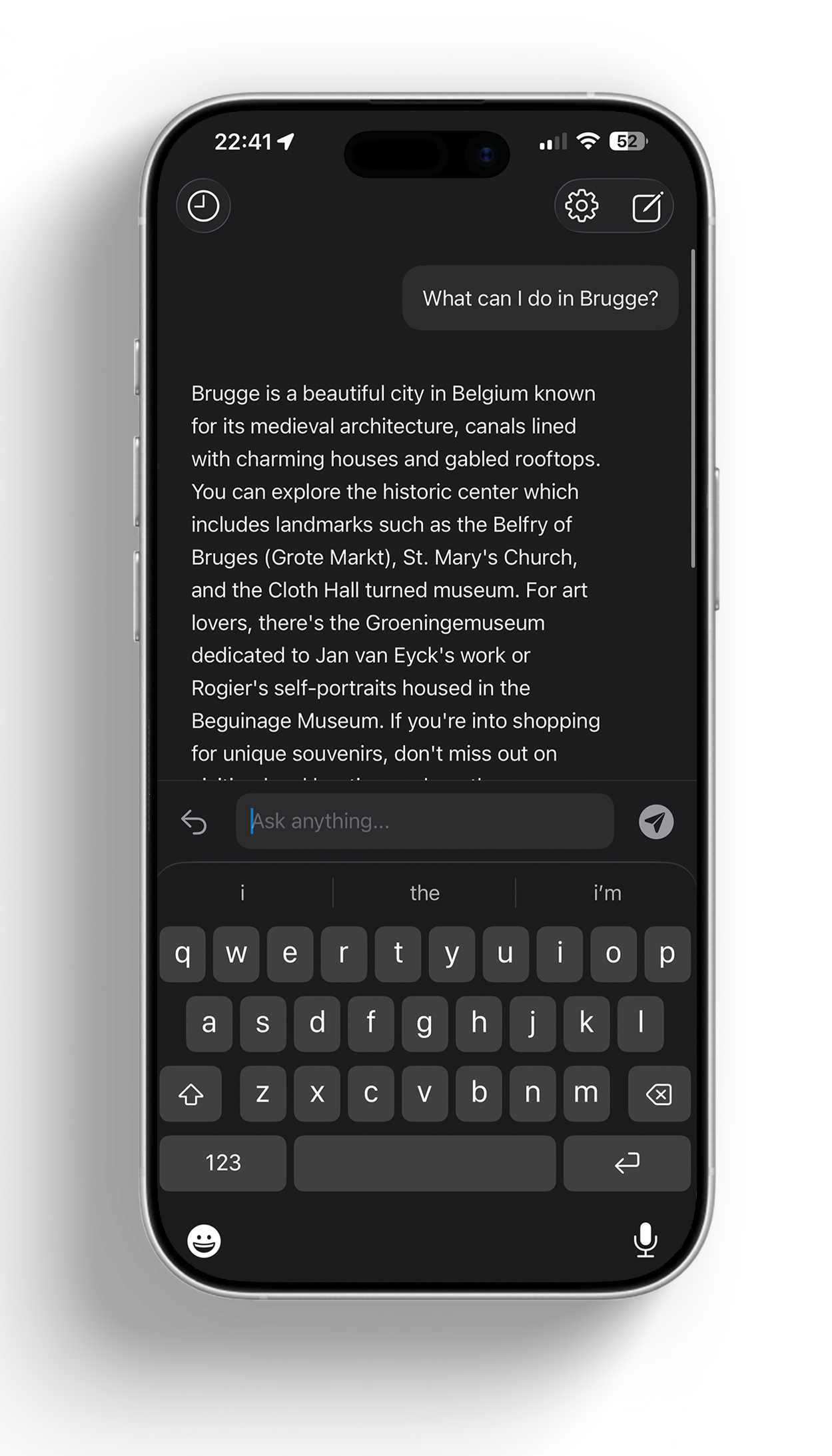

Funktioniert Überall.

U-Bahn, Flugzeug, Landschaft, Keller. LiberaGPT läuft vollständig auf dem Prozessor Ihres iPhones. Stellen Sie Fragen und erhalten Sie sofort Antworten – ohne Netzwerkverbindung.

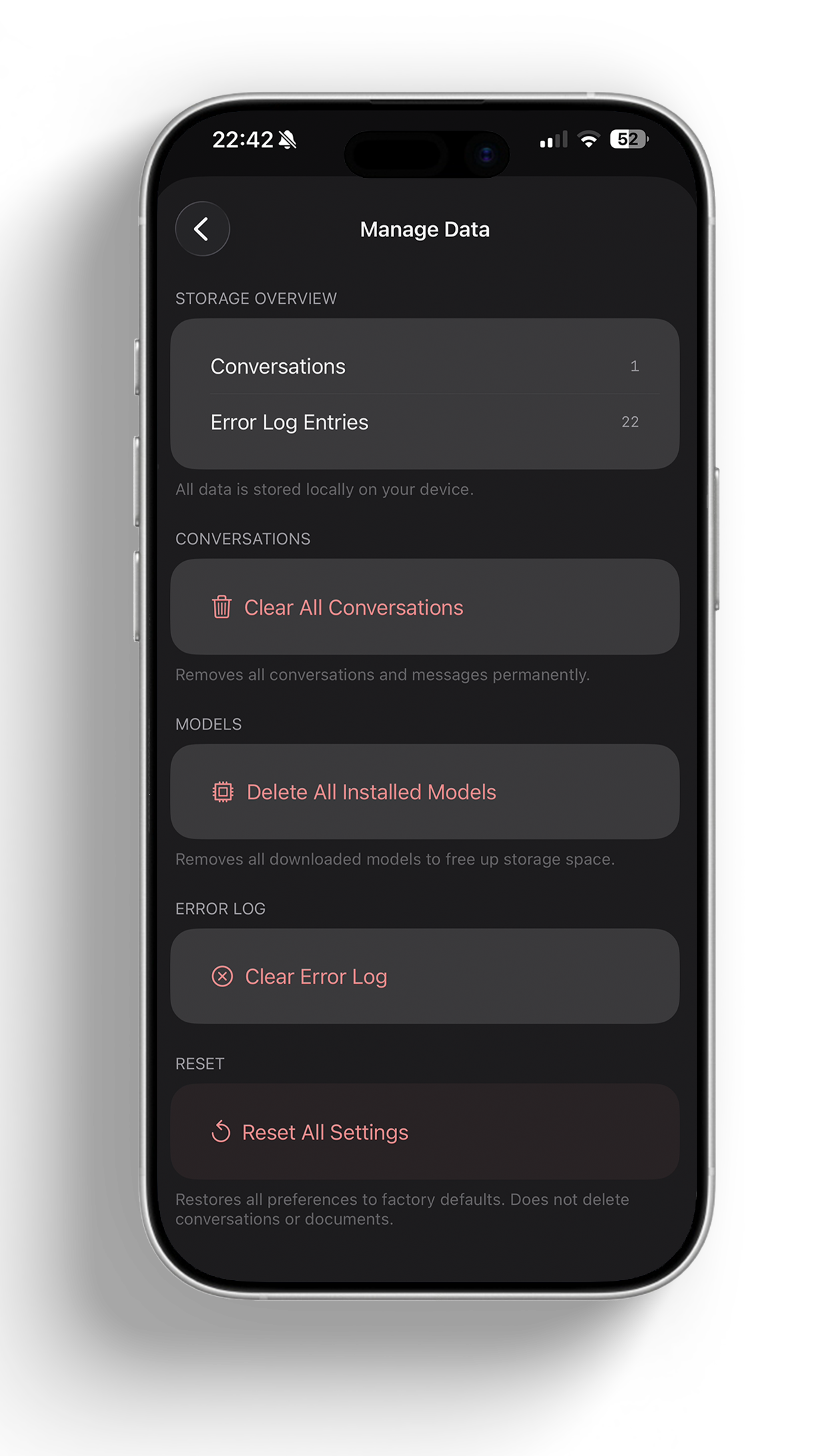

Ihre Daten Gehören Ihnen.

Löschen Sie Ihren Verlauf sofort. Nichts verlässt Ihr Telefon. Keine Cloud-Synchronisierung, keine Telemetrie, keine Trainingsdatenerfassung. Wenn wir privat sagen, meinen wir es ernst.

Alles läuft nativ auf Ihrem iPhone.

LiberaGPT verwendet quantisierte GGUF-Modelle mit A19 Neural Engine und Metal GPU-Beschleunigung und bietet Ihnen eine schnelle, intelligente KI, die Ihre Privatsphäre wirklich respektiert.

Vollständig Offline

Funktioniert in der U-Bahn, im Flugzeug, auf dem Land. Kein WLAN erforderlich. Niemals. Ihre Gespräche bleiben zwischen Ihnen und Ihrem Telefon.

Neural Engine Optimiert

A19 Neural Engine und GPU-Beschleunigung über Metal auf iPhone-17-Pro-Geräten. Quantisierte Modelle (Q4_K) balancieren Qualität und Geschwindigkeit. Schnelle Antworten mit minimalem Akkuverbrauch.

Keine Datenweitergabe

Nichts wird an unsere Server gesendet. Nichts wird an Apple gesendet. Ihre Gespräche werden nur auf Ihrem Gerät gespeichert und können jederzeit gelöscht werden.

Laden Sie Was Sie Möchten

Wählen Sie, welche KI-Modelle installiert werden sollen. Laden Sie leichte Modelle für schnelle Antworten oder spezialisierte Modelle für tiefere Denkaufgaben herunter.

Keine Wiederkehrenden Kosten

Einmal bezahlen. Für immer nutzen. Keine Abonnements, keine Token-Limits, keine unerwarteten Rechnungen. Für ernsthafte Arbeit nutzen Sie Cloud-KI. Für alles andere LiberaGPT.

Umweltfreundlich

Rechenzentren verbrauchen enorme Mengen Energie. Ihr Telefon verbraucht Watt, keine Kilowatt. Erhalten Sie einfache Antworten lokal, statt Energie in einer Serverfarm zu verbrennen.